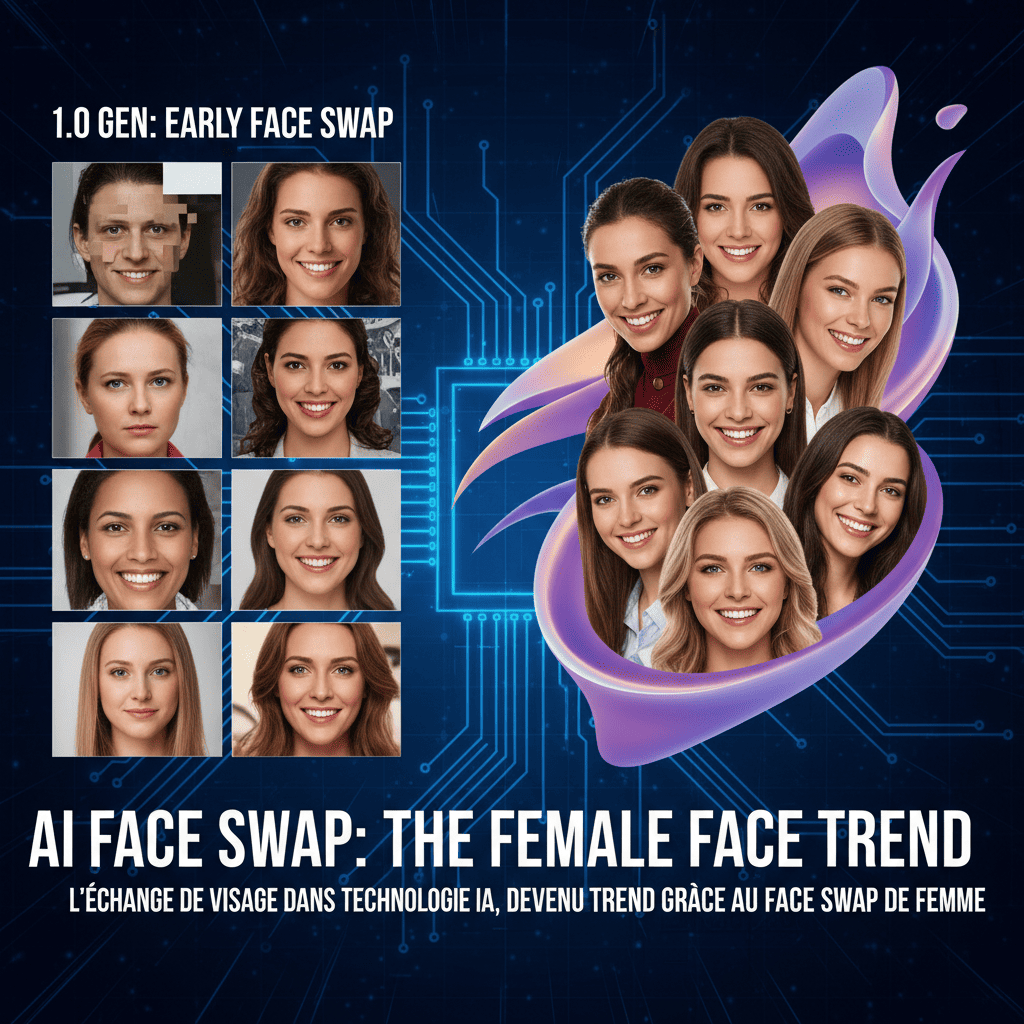

Il y a dix ans, le face swap n’était qu’un filtre amusant sur quelques applications. Les visages se collaient grossièrement l’un sur l’autre, les contours bavaient, et tout le monde voyait bien qu’il s’agissait d’un jeu. En 2026, la situation est radicalement différente. Les modèles d’IA capables de remplacer un visage dans une vidéo produisent des résultats si crédibles que, pour un spectateur non entraîné, la frontière entre tournage réel et montage devient floue.

Cette montée en réalisme a fait passer l’échange de visage du statut de gadget à celui d’outil de production. Studios, créateurs indépendants, marques et même escrocs se sont emparés de ces technologies. La même fonction peut servir à tourner une publicité globale, à anonymiser un témoin… ou à fabriquer une arnaque en visioconférence. Comprendre ce qu’est vraiment le face swap IA, comment il fonctionne, et ce qu’on est en droit d’attendre d’un service responsable n’a donc jamais été aussi important.

Du filtre de soirée à l’outil de studio

Les premiers effets d’échange de visage étaient tolérants avec l’imperfection. Tant que le rendu faisait rire, personne ne se plaignait des déformations, des yeux qui flottent ou des bouches mal alignées. Le face swap était un gimmick social, sans ambition particulière.

En quelques années, les modèles d’IA ont pourtant changé de catégorie. Ils n’essaient plus simplement de “coller” un visage sur un autre, mais de reconstruire une scène complète dans laquelle un nouveau visage s’intègre naturellement. Les ombres, la texture de la peau, le grain vidéo, la profondeur de champ : tout est recalculé pour donner l’illusion d’une prise de vue authentique.

Cette qualité a ouvert la porte à des usages professionnels. Certains studios utilisent l’échange de visage pour harmoniser des scènes tournées à des moments différents, adapter un spot publicitaire à plusieurs marchés, ou créer des personnages impossibles à filmer physiquement. Dans le contenu en ligne, des créateurs se servent du face swap pour jouer plusieurs rôles, incarner un avatar permanent, ou tester rapidement des concepts sans recruter une distribution complète.

Comment fonctionne un face swap IA moderne ?

Techniquement, un face swap IA ne se résume pas à un “copier-coller” visuel. On peut découper le processus en trois grandes étapes, qui se répètent à chaque image de la vidéo.

Analyse du visage d’origine

Le système commence par repérer les traits clés du visage filmé : contour, position des yeux, structure du nez, forme de la bouche, mouvement des joues lorsque la personne parle ou sourit. L’IA suit également l’orientation de la tête, la direction du regard et les variations de lumière sur la peau.

Cette phase d’analyse permet de construire une sorte de “squelette expressif” : un modèle qui résume la manière dont le visage se comporte au fil de la séquence, image après image.

Génération du visage de destination

Ensuite, le modèle intègre le visage de destination. Il peut s’agir d’une personne réelle, d’un personnage de fiction ou d’un visage entièrement synthétique. Contrairement aux approches anciennes, ce visage ne sert pas simplement de motif à coller. L’IA cherche à imaginer comment ce nouveau visage réagirait si c’était lui qui avait été filmé : même lumière, même angle, mêmes micro-expressions.

Les architectures de type diffusion ou les réseaux adversariaux modernes travaillent dans un espace de représentation très riche, générant pour chaque frame un visage qui respecte la dynamique de la scène.

Intégration dans la vidéo finale

Enfin, le rendu généré est fusionné avec le reste de la vidéo. Le système adapte les couleurs, le contraste, le grain, la compression, et ajoute parfois de légères imperfections pour rester crédible. Ce travail se répète des dizaines de fois par seconde.

Au bout du processus, on n’a plus la sensation d’un masque numérique, mais celle d’un visage qui a réellement occupé l’espace devant la caméra. C’est ce qui rend le face swap IA à la fois fascinant et potentiellement inquiétant.

Un outil de création aux usages multiples

On associe souvent l’échange de visage aux deepfakes scandaleux, mais une grande partie des usages reste parfaitement légitime. Dans le divertissement, des vidéastes l’utilisent pour interpréter plusieurs personnages dans un même plan, jouer avec leur propre image ou parodier des formats connus.

Dans la production audiovisuelle, le face swap permet par exemple de :

- retoucher une scène sans rappeler toute l’équipe de tournage ;

- adapter les mouvements de lèvres à une version doublée dans une autre langue ;

- insérer un avatar numérique dans un décor réel, sans passer par une capture de mouvement coûteuse.

Dans certains contextes sensibles, cette technologie peut aussi devenir un outil de protection. Remplacer le visage d’un témoin par un visage synthétique permettant de conserver sa voix, sa gestuelle, son émotion, tout en évitant qu’il soit reconnu, est une piste explorée par plusieurs rédactions. Le face swap n’est alors plus un moyen de tromper, mais une manière de concilier parole et sécurité.

Quand le swap de visage bascule du côté obscur

Plus le rendu est crédible, plus les dérives deviennent graves. Des escroqueries récentes s’appuient sur des appels vidéo truqués dans lesquels un dirigeant, un collègue ou un proche semble demander un accès, une information confidentielle ou un virement. Le visage est imité, la voix parfois aussi, et la victime, persuadée de parler à une personne de confiance, obéit.

D’autres montages visent l’humiliation ou la destruction de réputation. Associer quelqu’un à une vidéo intime qu’il n’a jamais tournée, le montrer dans une situation illégale ou moralement choquante, puis diffuser le tout auprès de son entourage ou de son employeur, suffit à provoquer des dégâts considérables. La nuance entre “vrai” et “faux” importe peu pour ceux qui réagissent à chaud.

Les conséquences ne sont pas seulement individuelles. À mesure que ces manipulations se multiplient, une forme de fatigue s’installe. Certaines personnes finissent par douter de tout, au point de considérer que plus aucune image n’est fiable. Le risque, à terme, est une érosion générale de la confiance dans les contenus visuels, y compris ceux qui sont authentiques.

Un encadrement juridique et éthique en construction

Face à ces dérives, les législateurs, les autorités de protection des données et les plateformes essaient de rattraper la technologie. Plusieurs pays ont déjà modifié leur droit pénal pour prendre en compte les montages explicites non consentis, même lorsque les images sont entièrement synthétiques. Les plateformes, elles, renforcent leurs politiques de modération et mettent en place des systèmes de signalement spécifiques pour les vidéos truquées.

L’éthique ne se limite pourtant pas à ce qui est “strictement illégal”. Il existe une zone grise où un face swap ne viole pas directement la loi, mais reste problématique : caricatures visant une personne fragile, montages destinés à humilier sans aller jusqu’à la menace, détournements qui exploitent un moment de vulnérabilité. Dans ces cas, la question n’est pas seulement de savoir ce que la loi autorise, mais ce que l’on considère comme acceptable dans un espace numérique déjà saturé de tensions.

Comment reconnaître un service d’échange de visage responsable ?

Pour un utilisateur qui souhaite expérimenter sans dépasser les limites, le choix de la plateforme est décisif. Les services sérieux ne se contentent pas de promettre un rendu “ultra réaliste”. Ils expliquent ce qu’ils font de vos données, ce qui est autorisé, et comment ils réagissent en cas d’abus.

Avant de confier des vidéos personnelles à un outil, quelques questions simples peuvent servir de filtre :

- le service décrit-il clairement les scénarios interdits ?

- la durée de conservation des fichiers est-elle indiquée ?

- est-il possible de demander la suppression définitive de ses contenus ?

- l’outil décourage-t-il explicitement les montages visant des personnes non consentantes ?

Un générateur sérieux prend la peine de poser ce cadre et de rappeler qu’un visage n’est pas une matière première comme une autre. Certains privilégient même le travail avec des visages synthétiques ou des avatars conçus pour être manipulés, plutôt qu’avec des photos d’inconnus récupérées en ligne.

Le face swap devient réellement dangereux au moment où l’on cesse de voir un visage comme celui d’une personne, et qu’on le traite comme un simple matériau graphique parmi d’autres.

Expérimenter sans se perdre : choisir une approche maîtrisée

Pour ceux qui souhaitent exploiter le potentiel créatif de ces technologies sans se noyer dans les dérives, l’enjeu n’est pas d’interdire l’échange de visage, mais de l’utiliser dans un environnement maîtrisé. Un générateur vidéo IA qui assume des règles claires, qui cible des usages adultes et consentis, et qui fait de la confidentialité un point central, offre un terrain d’expérimentation beaucoup plus sain qu’un service opaque.

Dans cette perspective, il est possible de s’appuyer sur un générateur de face swap fondé sur l’IA, conçu pour proposer des transformations avancées dans un cadre non censuré mais encadré, avec une politique de traitement des fichiers transparente et des limites d’usage explicitement posées. Ce type de solution permet d’explorer des scénarios de création, de tester des idées de contenu ou de prototyper des formats vidéo sans transformer l’outil en instrument de nuisance.

Questions fréquentes autour du swap IA

Ces montages sont-ils détectables à l’œil nu ?

Dans de nombreux cas, un utilisateur non spécialisé aura du mal à repérer un montage bien exécuté, surtout sur un écran de smartphone. Certains indices subsistent pourtant : clignements d’yeux légèrement irréguliers, incohérences de lumière, détails qui se déforment en arrière-plan. Mais à mesure que les modèles progressent, compter uniquement sur son intuition visuelle devient de moins en moins fiable.

Est-ce légal d’utiliser le visage d’une personne sans lui demander ?

Tout dépend du contexte, du pays et du type de contenu. Dans la plupart des juridictions, associer quelqu’un à une scène intime ou dégradante sans accord est clairement répréhensible, qu’il s’agisse d’images réelles ou générées. Même en dehors des situations évidentes, l’usage du visage d’autrui sans consentement peut engager la responsabilité civile. Le plus simple, dans le doute, reste de demander l’autorisation ou de recourir à des visages synthétiques.

Le face swap va-t-il tuer la confiance dans la vidéo ?

Il est probable que la confiance “automatique” accordée à une vidéo brute recule. Mais cela ne signifie pas que toute image deviendra inutile. Comme pour la photographie retouchée, une culture du doute raisonnable peut s’installer : on apprendra à demander d’où viennent les images, comment elles ont été produites, et quelles garanties les accompagnent. Les créateurs qui assumeront clairement l’usage d’outils d’IA, plutôt que de les dissimuler, auront sans doute un avantage à long terme.

Vers une maturité collective face aux images générées

Le face swap condense tout ce que l’intelligence artificielle apporte de plus puissant et de plus dérangeant à la vidéo. Il permet de raconter des histoires autrement, de créer des personnages impossibles, de protéger certains témoins, mais aussi d’organiser des arnaques sophistiquées ou d’alimenter des campagnes de harcèlement.

À court terme, il est illusoire de penser que ces outils disparaîtront. La question n’est donc pas de savoir s’il faut les accepter ou les rejeter en bloc, mais de définir ce que l’on en fait. Du côté des personnes qui produisent des contenus, cela implique de choisir des plateformes responsables, de poser clairement les limites et de privilégier les scénarios où tout le monde sait à quoi il s’engage. Du côté des spectateurs, cela suppose d’admettre que la vidéo n’est plus une preuve en soi, mais un élément parmi d’autres dans la construction d’un jugement.

Si cette double prise de conscience progresse, le face swap pourra rester une technologie utile, au service de la création et de la narration, plutôt qu’un simple symbole de méfiance généralisée envers tout ce que l’on voit à l’écran.

Laisser un commentaire